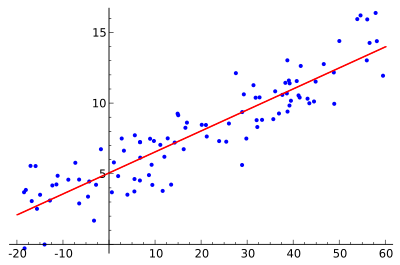

La régression linéaire est une méthode statistique servant à modéliser la relation entre une variable dépendante et une ou plusieurs variables explicatives à l'aide d'une relation linéaire en paramètres. Il s'agit d'un cas particulier de l'analyse de régression où les effets des variables explicatives s'expriment de façon additive et linéaire par rapport aux paramètres inconnus.

Principes et définitions

Dans sa forme la plus simple, la régression linéaire simple s'écrit :

y = β0 + β1 x + ε,

où y est la variable dépendante, x la variable explicative, β0 l'ordonnée à l'origine, β1 la pente et ε le terme d'erreur aléatoire (le résidu). En dimension multiple, on utilise la forme matricielle :

Y = Xβ + ε,

avec Y vecteur des observations, X matrice des variables explicatives, β vecteur des paramètres et ε vecteur des erreurs.

Objectifs et critère d'ajustement

Les modèles de régression linéaire cherchent à réduire l'écart entre les observations et la droite (ou l'hyperplan) prédite. Cet écart vertical est appelé résidu. Plusieurs critères d'ajustement sont possibles :

- Moindres carrés ordinaires (MCO) : minimisation de la somme des carrés des résidus — méthode la plus courante.

- Moindres valeurs absolues : minimisation de la somme des valeurs absolues des résidus (régression quantile, régression des moindres écarts absolus).

- Pénalisation : ajout d'un terme de régularisation (par exemple régression de crête / ridge, LASSO) pour contrôler la complexité du modèle.

- Poids ou modèles robustes : pondération des observations ou critères insensibles aux valeurs extrêmes (régression robuste).

La méthode des moindres carrés peut être utilisée même lorsque le modèle n'est pas linéaire en variables, mais la qualification « linéaire » en régression se rapporte à la linéarité par rapport aux paramètres β.

Estimation par moindres carrés

Lorsque la matrice X'X est inversible, l'estimateur des moindres carrés ordinaires s'écrit :

β̂ = (X'X)^{-1} X'Y.

Cet estimateur minimise la somme des carrés des résidus et est facile à calculer numériquement. Il est souvent suivi d'une analyse d'incertitude (« intervalles de confiance », tests d'hypothèses) fondée sur des approximations asymptotiques ou sur des hypothèses de normalité des erreurs.

Hypothèses usuelles

Pour que les estimateurs aient des propriétés statistiques souhaitables, les modèles linéaires reposent généralement sur plusieurs hypothèses :

- Modèle linéaire correct : la relation attendue entre Y et X est linéaire en paramètres.

- Erreurs centrées : E(ε | X) = 0.

- Homoscedasticité : variance constante des erreurs, Var(ε | X) = σ².

- Indépendance des erreurs : erreurs non corrélées entre observations (surtout important pour données temporelles).

- Absence de multicolinéarité parfaite : les colonnes de X sont linéairement indépendantes.

Selon le cadre, des hypothèses supplémentaires (comme la normalité des erreurs) sont posées pour permettre des tests exacts. Les conditions de Gauss–Markov garantissent que l'estimateur des moindres carrés est le meilleur estimateur linéaire non biaisé (acronyme BLUE).

Propriétés statistiques

- Sous les hypothèses de Gauss–Markov, β̂ est non biaisé et possède la plus faible variance parmi les estimateurs linéaires non biaisés.

- Si, en plus, les erreurs sont normales, les estimateurs sont distribués normalement et permettent des tests exacts et la construction d'intervalles de confiance.

- La performance du modèle se mesure souvent par le coefficient de détermination R², la statistique F, les erreurs standards des coefficients et les diagnostics sur les résidus.

Diagnostics et validation

L'évaluation d'un modèle de régression linéaire implique plusieurs vérifications :

- Analyse des résidus : recherche de non-linéarités, d'hétéroscédasticité ou de dépendance temporelle.

- Test d'hétéroscédasticité (par ex. Breusch–Pagan) et correction par pondération ou estimation robuste si nécessaire.

- Multicolinéarité : mesure par le facteur d'inflation de la variance (VIF) ; la multicolinéarité élevée rend les estimations instables.

- Points influents et outliers : identification à l'aide de distances de Cook, levier, etc.

- Validation croisée ou échantillons tests pour évaluer la capacité prédictive et éviter le surapprentissage.

Variantes et extensions

La régression linéaire a de nombreuses variantes destinées à répondre à des besoins spécifiques :

- Régression multiple : plusieurs variables explicatives.

- Régression pondérée (WLS) : prise en compte d'observations avec variances différentes.

- Ridge, LASSO et autres méthodes de régularisation pour lutter contre le sur-ajustement et la multicolinéarité.

- Régression robuste : méthodes moins sensibles aux valeurs aberrantes.

- Modèles linéaires généralisés (GLM) : extension aux variables dépendantes non gaussiennes (logistique, Poisson, etc.).

- Régression non linéaire et modèles additifs : quand la relation n'est pas linéaire en paramètres.

Applications

La régression linéaire est largement utilisée dans de nombreux domaines, notamment :

- Économétrie et analyse financière (prévision, évaluation d'impact).

- Sciences sociales et psychologie (explication de comportements).

- Sciences naturelles et ingénierie (modélisation empirique).

- Apprentissage automatique comme composante de modèles plus complexes.

Limites et précautions

Quelques limites importantes :

- La linéarité en paramètres ne garantit pas qu'une relation linéaire soit appropriée entre variables : un mauvais modèle peut conduire à des conclusions erronées.

- Les corrélations ne signifient pas nécessairement causalité.

- Les violations des hypothèses (hétéroscédasticité, erreurs corrélées, variables omises, multicolinéarité) peuvent biaiser les conclusions ou rendre les estimateurs peu fiables.

Brève histoire

La méthode des moindres carrés a été formalisée au début du XIXe siècle par Adrien-Marie Legendre et Carl Friedrich Gauss, et la régression linéaire est restée un fondement de la statistique en raison de sa simplicité, de son interprétabilité et de ses solides propriétés théoriques sous hypothèses appropriées.

En résumé

- La régression linéaire modélise la relation entre une variable dépendante et des variables explicatives de façon linéaire en paramètres.

- La méthode la plus utilisée est celle des moindres carrés, mais d'autres critères existent pour différents objectifs et contraintes.

- Une bonne pratique inclut la vérification des hypothèses, l'analyse des résidus, et l'utilisation de variantes ou de régularisation lorsque nécessaire.