La guerre froide

Voir aussi : Guerre de Corée, guerre du Vietnam, crise des missiles cubains, course à l'espace et ère Reagan

Après la Seconde Guerre mondiale, l'Union soviétique et les États-Unis étaient les deux pays les plus puissants qui restaient dans le monde. La guerre froide a été une période de tension entre les deux pays sur les modes de vie. Les deux pays ont essayé de rallier d'autres pays à leur cause. L'Union soviétique a essayé d'amener les pays à devenir communistes et les États-Unis ont essayé de les empêcher de l'être. Les soldats américains et soviétiques n'ont jamais combattu dans des batailles, mais ils ont combattu indirectement lors de la guerre de Corée (années 1950) et de la guerre du Vietnam (années 1950-1970).

La guerre de Corée n'a duré que quelques années, mais a conduit à la présence de soldats américains en Corée depuis lors. La guerre du Vietnam a duré beaucoup plus longtemps. Elle a commencé avec quelques troupes américaines au Vietnam, mais dans les années 1960, des milliers d'Américains ont été envoyés au Vietnam. Les deux guerres opposaient un gouvernement communiste du Nord aidé par l'Union soviétique et la Chine communiste et un gouvernement du Sud aidé par les États-Unis. La guerre de Corée a entraîné une scission de la Corée, mais la guerre du Vietnam a donné lieu à un Vietnam communiste après le départ des États-Unis en raison de la volonté du peuple américain de mettre fin à la guerre. Plus d'un quart de million d'Américains sont morts ou ont été blessés au Vietnam, ce qui constitue un véritable échec militaire. Les États-Unis et l'Union soviétique se sont disputés sur l'endroit où ils pourraient placer des armes nucléaires. L'un de ces arguments était la crise des missiles de Cuba. Pendant la crise des missiles de Cuba, les États-Unis et l'Union soviétique ont été très proches de s'attaquer l'un à l'autre avec des armes nucléaires.

Pendant la guerre froide, les États-Unis ont connu une "Red Scare", c'est-à-dire que le gouvernement a essayé de trouver des personnes qu'il pensait être communistes. La Chambre des représentants avait un groupe appelé le Comité des activités anti-américaines de la Chambre pour traiter de cette question, et Joseph McCarthy dirigeait des audiences au Sénat. La "Red Scare" a conduit des gens à perdre leur emploi, à aller en prison, et même à être exécutés. De nombreux acteurs et auteurs ont été mis sur des listes noires, ce qui signifie qu'ils ne pouvaient pas trouver de travail dans les films ou obtenir des crédits pour leurs écrits.

La guerre froide a commencé par une course aux armements entre les États-Unis et l'Union soviétique pour voir qui pourrait avoir des armes plus nombreuses et meilleures. Cette course a commencé après que les Soviétiques aient été le deuxième pays à développer une bombe atomique. Aux États-Unis, cela a donné naissance à ce que l'on appelle le "complexe militaro-industriel", ce qui signifie que les entreprises et le gouvernement ont travaillé ensemble pour dépenser beaucoup d'argent dans des projets d'armement à grande échelle. Les entreprises et le gouvernement s'aidaient mutuellement à obtenir plus d'argent et plus de pouvoir. Une partie de ce complexe était quelque chose appelé le "Plan Marshall", qui a reconstruit l'Europe tout en leur faisant acheter des produits américains. Le Complexe a permis l'émergence d'une classe moyenne croissante, mais a également permis à la guerre froide de perdurer.

Outre la course à l'armement, la "course à l'espace" a également fait partie de la guerre froide. Celle-ci a commencé lorsque les Soviétiques ont lancé un satellite dans l'espace appelé Spoutnik en 1957. Les Américains ont commencé à s'inquiéter du retard des États-Unis par rapport à l'Union soviétique et ont fait en sorte que leurs écoles se concentrent davantage sur les mathématiques et les sciences. En quelques années, les États-Unis et l'Union soviétique ont tous deux envoyé des satellites, des animaux et des personnes en orbite. En 1969, la mission Apollo 11 a mis Neil Armstrong et Buzz Aldrin sur la Lune.

La politique étrangère des États-Unis a changé dans les années 1970 lorsque les États-Unis ont quitté le Vietnam et que Richard Nixon a quitté le pouvoir en raison d'un scandale politique appelé Watergate. Dans les années 1970 et 1980, les États-Unis ont mené une politique de "détente" avec l'Union soviétique. Cela signifie que les deux pays ont signé des traités pour mettre fin à l'utilisation des armes. Sous Nixon et Reagan, les États-Unis ont envoyé des troupes et de l'argent à de nombreux gouvernements d'Amérique latine pour les empêcher d'être communistes. Cela a conduit à la violence en Amérique latine. À cette époque, l'économie a souffert du fait que les États-Unis ne fabriquaient plus autant de choses qu'auparavant et que certains pays du Moyen-Orient ne donnaient pas aux États-Unis autant de pétrole qu'ils le souhaitaient (c'est ce qu'on a appelé un "embargo pétrolier"). Le Moyen-Orient est devenu très important dans la politique étrangère américaine après que plusieurs Américains aient été kidnappés en Iran en 1979. Dans les années 1980, des membres du gouvernement américain ont vendu des armes à des Iraniens et ont donné l'argent à des soldats "contra" au Nicaragua. C'est ce qu'on a appelé "l'affaire Iran-Contra". Dans les années 1970 et 1980, les États-Unis ont normalisé leurs relations avec la Chine. La guerre froide a pris fin avec l'effondrement des gouvernements communistes en Union soviétique et dans d'autres pays.

Questions intérieures et sociales

Les États-Unis ont retrouvé leur prospérité. Des millions de blancs quittent les villes et les banlieues pour s'installer dans les États du Sud et de l'Ouest, connus sous le nom de "Sunbelt". Ils achètent de nouvelles voitures et des téléviseurs. Le taux de natalité a augmenté dans les années 1940 et 1950, dans ce que l'on a appelé le "Baby Boom". L'"ère spatiale" a inspiré l'art et l'architecture de style "Googie". Beaucoup plus de gens ont rejoint la classe moyenne, mais il y avait encore beaucoup de gens pauvres.

La pauvreté était la plus répandue chez les Afro-Américains. La plupart d'entre eux vivaient dans des quartiers pauvres des villes du Nord, ou dans le Sud où ils étaient confrontés au racisme et à la ségrégation "Jim Crow". Ces conditions ont conduit au mouvement des droits civiques des années 1950, dirigé par Martin Luther King Jr. et d'autres. En 1954, la Cour suprême a déclaré la ségrégation scolaire illégale dans l'affaire Brown v. Board of Education, même s'il faudra attendre plusieurs années avant que la ségrégation scolaire ne prenne fin. En 1955, Martin Luther King a mené un boycott des bus à Montgomery, en Alabama. À la fin des années 1950 et dans les années 1960, King reçoit l'aide des présidents John F. Kennedy, qui est abattu, et Lyndon B. Johnson. En 1963, il mène une marche sur Washington pour réclamer les droits civils. Peu après, le Congrès a adopté des lois qui rendaient la plupart des ségrégations illégales. Johnson a également fait passer un programme appelé la Grande Société qui a aidé les pauvres et les minorités.

Les gays et les lesbiennes, qui ont souvent été persécutés, ont également commencé à réclamer des droits, à partir des émeutes de Stonewall en 1969. Les Chicanos, les Amérindiens, les personnes âgées, les consommateurs et les personnes handicapées se sont également battus pour obtenir des droits, tout comme les femmes. Bien que les femmes aient eu des emplois pendant la Seconde Guerre mondiale, la plupart d'entre elles sont retournées à la maison après la guerre. Les femmes n'aimaient pas le fait qu'elles occupaient souvent des emplois moins bien payés que les hommes ou que moins de possibilités s'offraient à elles. Des personnes comme Betty Freidan et Gloria Steinem ont fondé des groupes tels que l'Organisation nationale des femmes pour tenter de résoudre ces problèmes. NOW et d'autres groupes voulaient un amendement sur l'égalité des droits qui leur garantirait l'égalité dans tous les domaines. Dans les années 1970 et 1980, beaucoup plus d'emplois et de possibilités ont été ouverts aux femmes. Certaines femmes, comme Phyllis Schlafly, se sont opposées à Freidan et Steinem et ont été qualifiées d'"anti-féministes". C'est en partie à cause des anti-féministes que l'amendement sur l'égalité des droits a été rejeté, mais aussi parce que les femmes avaient déjà obtenu l'égalité dans de nombreux domaines et qu'elles ne voulaient pas être enrôlées dans l'armée.

Dans les années 1960, la contre-culture a été créée. Certains des adeptes de la contre-culture étaient appelés hippies. Ils avaient les cheveux longs et vivaient en communauté, fumant de la marijuana et pratiquant l'amour libre. La contre-culture, ainsi que les étudiants, étaient les groupes les plus opposés à la guerre du Vietnam. C'étaient également les groupes qui écoutaient la nouvelle musique connue sous le nom de rock and roll.

En 1973, la Cour suprême a rendu une décision appelée Roe v. Wade, qui a rendu légal de nombreux avortements. Les nombreux changements ont entraîné une réaction de Jerry Falwell et d'autres conservateurs qui se sont appelés la "droite religieuse" et la "majorité morale".

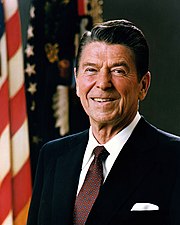

L'ère Reagan

Ronald Reagan a été élu président en 1980. Il a battu le président sortant Jimmy Carter en remportant 44 des 50 États américains. Pendant l'ère Reagan, le pays était confronté à l'inflation, à une mauvaise économie, et la politique étrangère américaine n'était pas aussi bonne. Lorsque Ronald Reagan est devenu président, il a signé le Economic Recovery Tax Act de 1981 qui a réduit les impôts des sociétés, soi-disant pour qu'elles puissent réinvestir les bénéfices excédentaires dans les affaires. Pendant la présidence de Reagan, il a développé l'armée américaine en créant plus d'emplois, mais aussi en augmentant le déficit dû aux dépenses excessives. Durant son premier mandat, l'économie est passée de 4,5% à 7,2%.

En 1984, Reagan a remporté une victoire écrasante en remportant 49 des 50 États américains. Au cours de son deuxième mandat, Reagan s'est concentré sur la fin de la guerre froide. Il a organisé de nombreuses rencontres entre Margaret Thatcher, le pape Jean-Paul II et le dirigeant soviétique Mikhaïl Gorbatchev. Ils se sont rencontrés pour la première fois au sommet de Genève en 1985. Plus tard, ils ont tous deux découvert leur passion pour la fin de la guerre. Reagan a rencontré à quatre reprises le dirigeant soviétique Mikhaïl Gorbatchev, qui est monté au pouvoir en 1985, et leurs conférences au sommet ont abouti à la signature du traité sur les forces nucléaires à portée intermédiaire.

Au cours de son second mandat, l'invasion de la Grenade et le bombardement de la Libye par Reagan ont également été populaires aux États-Unis, bien que son soutien aux rebelles des Contras se soit enlisé dans la controverse sur l'affaire Iran-Contra qui a révélé le mauvais style de gestion de Reagan.

Depuis qu'il a quitté ses fonctions en 1989, Reagan est devenu l'un des présidents les plus populaires des États-Unis.

.svg.png)

,_by_John_Trumbull.jpg)

.webm.jpg)

.webm.jpg)